Mi vezetheti félre az önvezető autót? Kell félnünk attól, hogy a rendszer rossz döntést hoz? A legrosszabb forgatókönyvek egyike például, hogy egy állj, elsőbbségadás kötelező (stop) tábla mellé kihelyezett plakát, vagy másik tábla megbolondítja a rendszert. A Bosch kutatói ezeket a problémás eseteket modellezik és keresnek válaszokat a fenti kérdésekre.

Ahogy a mesterséges intelligencia alkalmazása és a gépi tanulás egyre általánosabbá válik, sokakban felmerülhet a kérdés, hogyan biztosítható, hogy ezek a rendszerek minden körülmények között megbízhatóan működjenek a hétköznapok során. Különösen fontos mindez az olyan esetekben, amikor mesterséges intelligencia alapú rendszereket alkalmaznak biztonsági szempontból kritikus területeken, például önvezető járműveknél vagy az épületek automatizált vezérlésére.

Ezekre a területekre fókuszál a Defence Advanced Research Projects Agency (DARPA), a Carnegie Mellon Egyetem és a Bosch Research közös kutatása, amely a mesterséges intelligenciával működő rendszerek biztonságát vizsgálta. A kutatók a gépi tanulási rendszerek tökéletesítését tűzték ki célul, hogy minden esetben, még a biztonsági szempontból legrosszabb forgatókönyvek esetén is megfelelő döntést hozzanak a rendszerek.

Elég lehet egyetlen másik tábla, hogy nehéz helyzetbe kerüljön a rendszer

Elég egy apró eltérés

Melyek ezek a forgatókönyvek? Olyan esetekben fordulhatnak elő, amikor egy látszólag apró, a legtöbb ember számára jelentéktelennek tűnő változás következtében a tanulásra képes algoritmusok téves döntéseket hozhatnak. Az alábbi kép egy ilyen esetet mutat be: az első ábrán az önvezető jármű könnyedén azonosítja a stoptáblát, az autó megáll.

A másik esetben hibázik a rendszer és rossz döntést hoz. A problémát itt a tábla mellé kihelyezett plakát okozza. A két jelet, vagyis a táblát és a mellette található plakátot a mesterséges intelligencia vázaként azonosítja és nem táblaként, az autó pedig megállás nélkül tovább hajt. Vagyis ebben az esetben a képalapú objektumfelismerő rendszerek rosszul azonosítják a jelzést, a jármű vezérlőrendszere emiatt nem megfelelően reagál.

Zavar az erőben

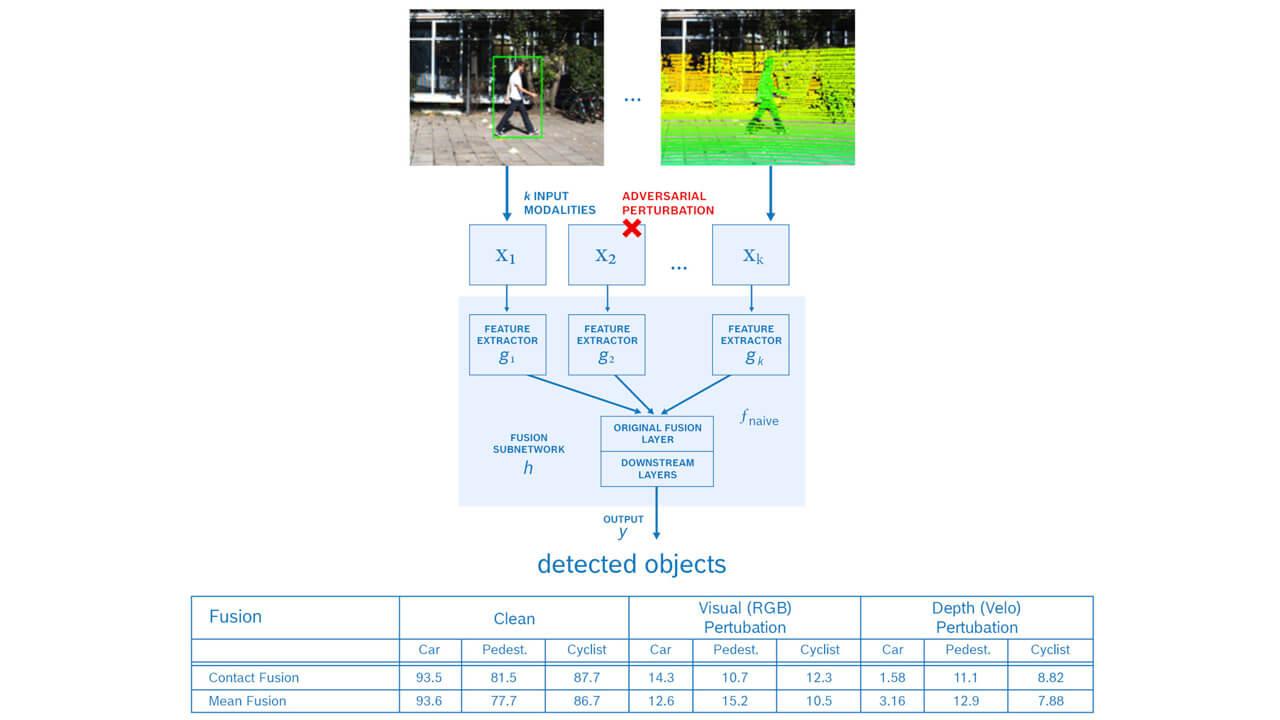

Előfordulhat az is, hogy csupán egyetlen szenzor hibásodik meg. Bár gondolhatjuk azt, hogy ha csak egy érzékelőt zavar valami, de a többi megfelelően funkcionál, akkor a rendszer összességében pontosan működik majd. Csakhogy ez nem feltétlenül igaz, az önvezető járművek esetében használt multimodális tárgydetektor pontossága egyetlen érzékelő meghibásodása esetén is 80-ról 10 százalékra csökkenhet.

Ha egy szenzor meghibásodik azt is kezelnünk kell

Néha több kamera sem elég

Hasonlóképpen problémás lehet például az úttestre került zavaró tárgy miatt még egy többnézetű kamerarendszer működése is. A közös biztonságos infrastruktúrának is nevezett rendszerek esetében több kamera, beleértve a térfigyelő kamerákat és a járművekre szerelteket is, több nézetből látja a környezetet, és mindegyik vezérlő információt cserélhet a többivel. Így még akkor is következtetni lehet arra, hogy milyen akadályok lehetnek egy jármű előtt, ha valamelyik kamera azt nem látja. Annak ellenére ugyanis, hogy egyes kameranézetekben nem látunk tárgyakat más eszközök által azok észlelhetőek maradnak. Ez az optimis elképzelés, de amennyiben a tárgy egyszerre több kamera előtt is takarásban van, akkor a többnézetű rendszer sem működik megfelelően.

Három kamera, egy plüssfigura

A szakemberek feladata tehát az, hogy megoldást találjanak az ilyen esetekre, és a rendszert felkészítsék a zavaró körülmények ellenére is a megfelelő döntések meghozására. A mérnökök ezért olyan szituációkat kezdtek el modellezni, amelyekben a fentiekhez hasonló legrosszabb forgatókönyvek valósulnak meg, hogy fel tudják készíteni ezekre az esetekre a mesterséges intelligencia alapú rendszereket. Kísérletükben három különböző statikus kameranézetből rögzítettek egy elképzelt közlekedési szituációt. A három kamera (C1 Mini Tripod, C2 Big Tripod és C3 Car) mindegyikén egy előre betanított szabványos YOLOv5 tárgydetektor applikáció működik és minden kamera megosztja a tárgyészlelési adatait a többivel.

A kísérlet során azt az élethelyzetet modellezték amikor két kamera (Big Tripod és Mini Tripod) észlel egy játékállatot, a harmadik előtt azonban ez takarásban marad. A két kamera információkat küld az észlelt játékról, a harmadik kamera pedig megbecsüli annak helyzetét. Így a többnézetű elosztott észlelési rendszer segít az ilyen objektumok észlelésében.

Amennyiben viszont a játék a két kamera (Big Tripod és Mini Tripod) takarásában helyezkedik el, a tárgydetektorok nem tudják észlelni az úton található objektumot. Mivel egyik kamera sem érzékeli a plüsst, emiatt az „autós” kamera sem kap információt az úton lévő tárgyról, vagyis a többnézetű rendszer ebben az esetben már nem működött jól.

Felkészülni a legrosszabbra

Ez az egyszerű kísérlet a rendszerek sebezhetőségét szemlélteti, és komoly aggályokat vet fel az ilyen, biztonság szempontjából kritikus alkalmazások valós körülmények közötti integrálásával kapcsolatban.

Van amikor emberként sem egyszerű azonosítani a táblákat, pedig nem mindig van idő gondolkodni

Ezek a legrosszabb forgatókönyvek – ha nem veszik figyelembe az MI-rendszerek tervezésekor – komoly problémákat okozhatnak, függetlenül a módozatok vagy kamerák és érzékelők számától. A Bosch Research éppen ezért olyan gépi tanulási módszereket fejleszt, amelyek képesek megbirkózni az ilyen, kimondottan nehéz forgatókönyvekkel is.